引言

超限学习机(ELM)是由Huang等[1-3]提出的一种单隐层前馈式神经网络算法.与传统的神经网络训练算法不同,ELM对隐节点的输入权值随机赋值,通过求解线性方程组得到输出权值.ELM具有训练速度极快、泛化性能强和调节参数较少等优点,已广泛地应用于机器学习等领域[3-5].在实际问题中,由于受诸多因素的影响,数据集通常包含噪声[6-7],ELM对这类数据集的预测精度低且预测结果波动较大.

正则化ELM[3]将输出权值的范数作为目标函数的正则化项,通过最小化结构风险,显著提高了ELM的学习性能.根据训练误差,Deng等[8]提出加权正则化(weighted ELM, WELM),通过两次迭代加权方法来削弱噪声的影响.然而,WELM在很大程度上依赖于初始迭代中学习的准确性,并且未必仅在两次迭代后收敛.上述方法都采用2-范数损失函数来构造ELM模型.该损失函数只有在训练点误差服从正态分布时是最优的.然而,许多实际应用问题并不能保证误差服从正态分布,这导致超限学习机对噪声样本点较敏感、鲁棒性差.

在机器学习领域,鲁棒损失函数是鲁棒算法设计的关键思路之一.研究人员提出了Huber损失函数[9]、1-范数损失函数[10]和Pinball损失函数[11]及其相应的改进ELM模型.然而,Huber、1-范数和Pinball损失函数的鲁棒性仍然较差,因为它们与训练误差之间是线性关系.Chen等[12]同时考虑正则化项(2-范数或1-范数) 和不同的损失函数(1-范数、Huber、bisquare和Welsch),提出了统一的鲁棒正则化ELM,并通过迭代加权算法求解所建模型.该方法在不同离群值比例下具有对数据集稳定且良好的泛化性能.除了文献[12]中提到的bisquare和Welsch函数外,上述方法均采用凸损失函数.

随着研究的深入,研究人员发现基于非凸损失函数的机器学习算法对受噪声干扰的数据集具有较强的鲁棒性[13-16].非凸损失函数也称为ramp损失函数[13]、truncated损失函数[14]或capped损失函数[16].经典机器学习方法中的损失函数如hinge损失、ε-敏感损失、2-范数被非凸损失函数所取代,构造了相应的鲁棒学习算法.近年来,随着信息论的不断发展,相关熵被用来解决监督和非监督学习问题[17-18].相关熵是由Liu等[17]于2007年提出的一种建立在Gauss核函数上的非线性局部相似性度量,能够弱化噪声在学习过程中的作用,已经被成功地应用于鲁棒学习和信号处理领域[18].Xing等[19]提出了基于最大相关熵准则的ELM模型,利用半二次规划求解所建模型,数值实验表明所提出的方法优于ELM和正则化ELM.由相关熵衍生的C-损失函数[20]和非凸光滑损失[21]及其相应学习模型被证实对噪声数据具有较强的鲁棒性.非凸光滑损失[21]是文献[12]中Welsch函数的另一种形式.作为建立在Gauss核函数上的度量,相关熵及其衍生损失函数[19-21]本质上是非凸指数函数,且指数部分均为2-范数.考虑到2-范数损失函数过分强调训练误差的作用,文献[11,22]提出了基于相关熵Laplace损失函数的ELM分类模型[11]和支持向量机模型[22].该模型[11]虽然能够弱化噪声对学习性能的影响,但需要迭代求解二次规划,这种方式不仅计算复杂度高,而且丧失了ELM模型运行速度极快且易于实现的显著优势.

受上述研究的启发,本文在相关熵的基础上,提出指数Laplace损失函数,并将其引入到ELM框架,建立能够弱化噪声负面作用的鲁棒ELM回归估计(ELRELM)模型.该模型的损失函数具有对称、非凸、有界且能够趋近于Laplace损失函数的性质,可通过迭代求解加权ELM实现.在每次迭代中,只需通过求解线性方程组就能得到模型的最优解,能够保持ELM解的结构优势.同时,在学习过程中,噪声样本点被赋予较小的权值,能够有效地提高预测精度.真实数据集在不同比例噪声下的数值实验验证了提出的ELRELM模型的有效性.

1 超限学习机

已知回归估计训练集{(xi,yi)![]() ,xi∈Rd,yi∈R.具有L个隐节点和激活函数hi(x)的单隐层ELM的输出函数的数学表示如下:

,xi∈Rd,yi∈R.具有L个隐节点和激活函数hi(x)的单隐层ELM的输出函数的数学表示如下:

(1)

其中β=[β1,β2,…,βL]T是输出权值向量, h(x)=[h1(x),h2(x),…,hL(x)]为变量x的隐层输出.记y=[y1,y2,…,yN]T,隐层输出矩阵H=[h(x1),h(x2),…,h(xN)]T,ELM模型[2-3]可表达为如下优化问题:

(2)

其中C为正则化参数.由最优性条件,优化问题(2)的最优解为

(3)

其中I为单位矩阵.

2 指数Laplace损失函数及性质

2.1 指数Laplace损失函数

图1 不同λ值下的指数Laplace损失函数 lλ(z)

Fig. 1 Exponential Laplace loss function lλ(z) with different λ values

在信息理论学习中,相关熵被认为是一个广义的局部相似度度量.它是建立在Gauss核函数g(z)=e-z2/λ,λ>0基础上的非凸函数.Singh等[20]和Feng等[21]分别建立了相关熵的衍生函数: C-损失函数和非凸光滑损失函数.它们都是非凸指数函数,能够明确限定噪声数据所造成的损失上界,抑制噪声对学习模型的影响.注意到这两个衍生函数的指数部分都是2-范数,这将在学习过程中过分强调噪声数据的负面作用.为了削弱 2-范数函数对噪声的敏感性,文献[11,22]提出了基于相关熵Laplace函数的支持向量机模型和超限学习机分类模型.针对回归估计问题,本文提出指数Laplace损失函数:

lλ(z)=λ(1-e-|z|/λ),

(4)

其中λ>0.图1 给出了不同λ值下的指数Laplace损失函数lλ(z)的图形.

2.1 性质

性质1 指数Laplace损失函数lλ(z)非负、对称、有界,且满足

性质2 除z=0外,lλ(z)可微且其导数有界,且limz→+∞l′λ(z)=0.

分析 l′λ(z)=sgn(z)e-|z|/λ,易得到limz→+∞l′λ(z)=0.从M-估计的角度,当数据集存在噪声即误差|z|较大时,lλ(z) 是鲁棒损失函数.

性质3 当k=1时,limλ→+∞lλ(z)=|z|.

分析 由Taylor展开式![]() 得到

得到

因此,当k=1时,limλ→+∞lλ(z)=|z|.

3 基于指数Laplace损失函数的回归估计鲁棒ELM

及其迭代求解算法

由图1和lλ(z)的性质可知,该有界损失函数能够有效削弱噪声对模型的影响.因此,本文提出基于指数Laplace损失函数lλ(z)的鲁棒ELM模型,其优化问题具有如下形式:

(5)

由于建立在相关熵Laplace损失函数的超限学习机[11]需要迭代求解二次规划,该方法不仅计算复杂度高,而且丧失了ELM模型求解较小规模线性方程组以及易于实现的优势.为了获得更快的学习速度,同时保持ELM解的结构优势,本文利用迭代重赋权算法求解所建模型(5).

令

(6)

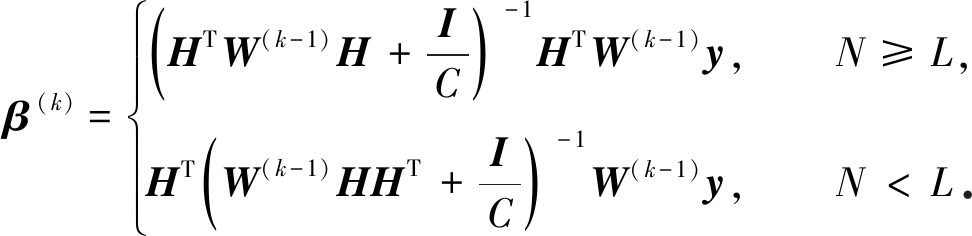

其中ξi=yi-h(xi)β.由最优性条件和文献[12],可得优化问题(5)的最优解:

(7)

其中对角矩阵W=diag(w1,w2,…,wN).当W为单位矩阵时, ELRELM为ELM.

算法1 迭代重赋权算法求解ELRELM

输入: 训练集{(xi,yi)![]() .

.

初始化: 参数C,隐节点数L,隐层输出矩阵H,最大迭代次数kmax和很小的ρ>0.

令W(0)=I和k=1.

输出: 最优解β*.

Step 1 由下式计算β(k):

(8)

Step 2 由式(1)得到f(k)(x), 利用式(6)更新![]() 和W(k),其中ξi(k)=yi-f(k)(xi).

和W(k),其中ξi(k)=yi-f(k)(xi).

Step 3 通过式(8)更新β(k+1).

Step 4 若k<kmax且‖β(k+1)-β(k)‖≥ρ,则令k![]() k+1,返回step 2.

k+1,返回step 2.

Step 5 否则终止迭代,输出β*,得到决策函数f(x)=h(x)β*.

4 数值实验

为了验证本文ELRELM的有效性,对9个真实数据集进行数值实验,并与正则化ELM[3]、加权ELM(WELM)[9]和迭代重加权ELM(iteratively re-weighted ELM, IRWELM)[12]进行比较.正则化参数C来自{2-19,2-18,…,218,219},ELRELM中参数λ的搜索范围为{0.05,0.1,0.15,…,0.85,0.9,0.95,1,1.5,2,…,4,4.5,5}.所有最优参数均通过网格搜索来实现.采用sigmoid函数为激活函数,隐节点数目L=200,最大迭代次数kmax=20.均方根误差εRMSE和平均绝对误差εMAE是评价模型学习性能的两个常用指标[15]:

其中m为测试样本点数目,yi 和![]() 分别表示测试样本点输出的真实值和预测值.通常来说,评价指标εRMSE,εMAE值越小,说明模型的学习性能越好.

分别表示测试样本点输出的真实值和预测值.通常来说,评价指标εRMSE,εMAE值越小,说明模型的学习性能越好.

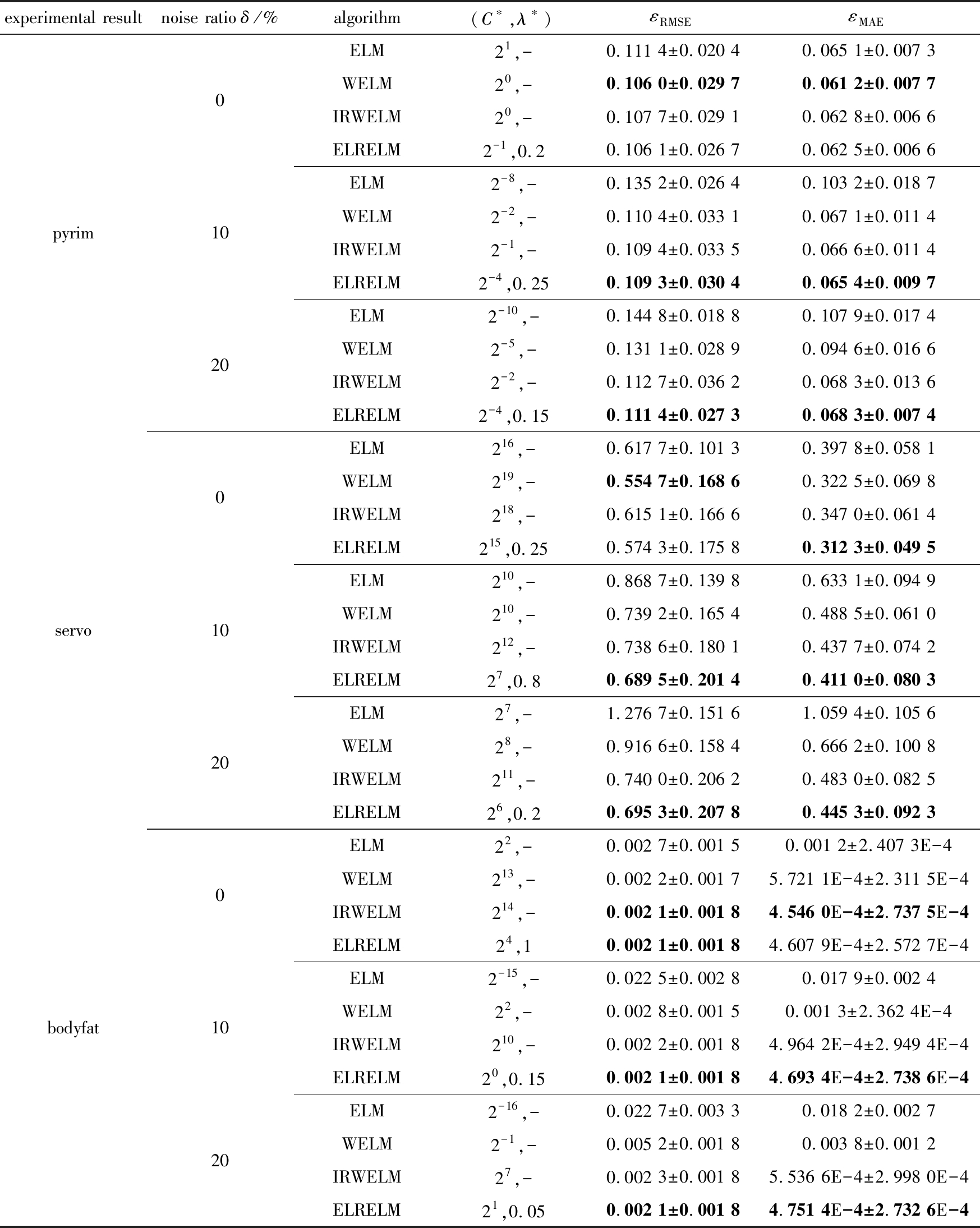

表1 Pyrim、servo和bodyfat数据集的实验结果

Table1 Experimental results of pyrim, servo and bodyfat datasets

experimentalresultnoiseratioδ/%algorithm(C∗,λ∗)εRMSEεMAEpyrim0ELM21,-0.1114±0.02040.0651±0.0073WELM20,-0.1060±0.02970.0612±0.0077IRWELM20,-0.1077±0.02910.0628±0.0066ELRELM2-1,0.20.1061±0.02670.0625±0.006610ELM2-8,-0.1352±0.02640.1032±0.0187WELM2-2,-0.1104±0.03310.0671±0.0114IRWELM2-1,-0.1094±0.03350.0666±0.0114ELRELM2-4,0.250.1093±0.03040.0654±0.009720ELM2-10,-0.1448±0.01880.1079±0.0174WELM2-5,-0.1311±0.02890.0946±0.0166IRWELM2-2,-0.1127±0.03620.0683±0.0136ELRELM2-4,0.150.1114±0.02730.0683±0.0074servo0ELM216,-0.6177±0.10130.3978±0.0581WELM219,-0.5547±0.16860.3225±0.0698IRWELM218,-0.6151±0.16660.3470±0.0614ELRELM215,0.250.5743±0.17580.3123±0.049510ELM210,-0.8687±0.13980.6331±0.0949WELM210,-0.7392±0.16540.4885±0.0610IRWELM212,-0.7386±0.18010.4377±0.0742ELRELM27,0.80.6895±0.20140.4110±0.080320ELM27,-1.2767±0.15161.0594±0.1056WELM28,-0.9166±0.15840.6662±0.1008IRWELM211,-0.7400±0.20620.4830±0.0825ELRELM26,0.20.6953±0.20780.4453±0.0923bodyfat0ELM22,-0.0027±0.00150.0012±2.4073E-4WELM213,-0.0022±0.00175.7211E-4±2.3115E-4IRWELM214,-0.0021±0.00184.5460E-4±2.7375E-4ELRELM24,10.0021±0.00184.6079E-4±2.5727E-410ELM2-15,-0.0225±0.00280.0179±0.0024WELM22,-0.0028±0.00150.0013±2.3624E-4IRWELM210,-0.0022±0.00184.9642E-4±2.9494E-4ELRELM20,0.150.0021±0.00184.6934E-4±2.7386E-420ELM2-16,-0.0227±0.00330.0182±0.0027WELM2-1,-0.0052±0.00180.0038±0.0012IRWELM27,-0.0023±0.00185.5366E-4±2.9980E-4ELRELM21,0.050.0021±0.00184.7514E-4±2.7326E-4

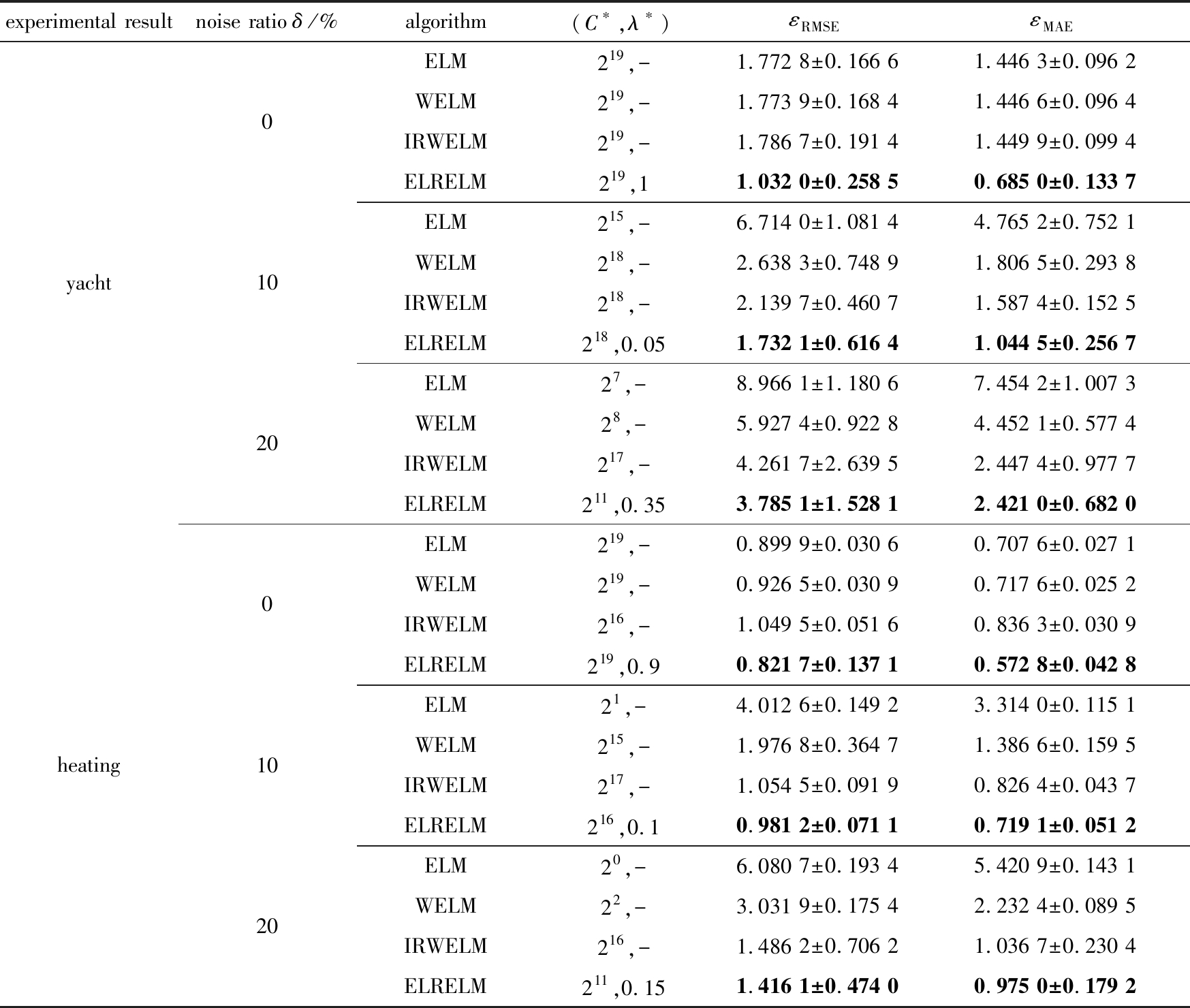

在实验过程中,对每个数据集,采用文献[12]的噪声干扰方式,对训练集的输出加入不同比例的来自于[ymin,ymax]的随机数噪声,测试集不加入任何噪声.对5个数据集pyrim、servo、bodyfat、yacht和heating在加入0%,10%和20%噪声情形进行实验.表1和表2给出了5个数据集的实验结果,包括在不同比例噪声下各算法的最优参数、预测精度εRMSE和εMAE.实验结果均为10次独立实验的平均结果,粗体表示这些算法中的最好结果.

由表1和表2可知,除了在加入0%噪声情形的pyrim、servo和bodyfat数据集外,ELRELM都获得了优于3种对比算法的预测精度,具有最小的εRMSE和εMAE值.并且,ELRELM在这3个数据集没有噪声干扰情形的预测精度排名第二.当加入噪声时,这4种算法的预测精度均不同程度地下降,体现在各算法的εRMSE和εMAE值增加.随着噪声比例的增加,ELM的学习性能急剧下降,WELM和IRWELM的预测精度也有所下降.ELRELM始终保持稳定且较好的学习性能.以20%噪声情形的Yacht数据集为例,ELRELM算法所获得的εRMSE比ELM提高了57.78%,比WELM提高了36.14%,比IRWELM提高了11.18%.

表2 Yacht和heating数据集的实验结果

Table 2 Experimental results of yacht and heating datasets

experimentalresultnoiseratioδ/%algorithm(C∗,λ∗)εRMSEεMAEyacht0ELM219,-1.7728±0.16661.4463±0.0962WELM219,-1.7739±0.16841.4466±0.0964IRWELM219,-1.7867±0.19141.4499±0.0994ELRELM219,11.0320±0.25850.6850±0.133710ELM215,-6.7140±1.08144.7652±0.7521WELM218,-2.6383±0.74891.8065±0.2938IRWELM218,-2.1397±0.46071.5874±0.1525ELRELM218,0.051.7321±0.61641.0445±0.256720ELM27,-8.9661±1.18067.4542±1.0073WELM28,-5.9274±0.92284.4521±0.5774IRWELM217,-4.2617±2.63952.4474±0.9777ELRELM211,0.353.7851±1.52812.4210±0.6820heating0ELM219,-0.8999±0.03060.7076±0.0271WELM219,-0.9265±0.03090.7176±0.0252IRWELM216,-1.0495±0.05160.8363±0.0309ELRELM219,0.90.8217±0.13710.5728±0.042810ELM21,-4.0126±0.14923.3140±0.1151WELM215,-1.9768±0.36471.3866±0.1595IRWELM217,-1.0545±0.09190.8264±0.0437ELRELM216,0.10.9812±0.07110.7191±0.051220ELM20,-6.0807±0.19345.4209±0.1431WELM22,-3.0319±0.17542.2324±0.0895IRWELM216,-1.4862±0.70621.0367±0.2304ELRELM211,0.151.4161±0.47400.9750±0.1792

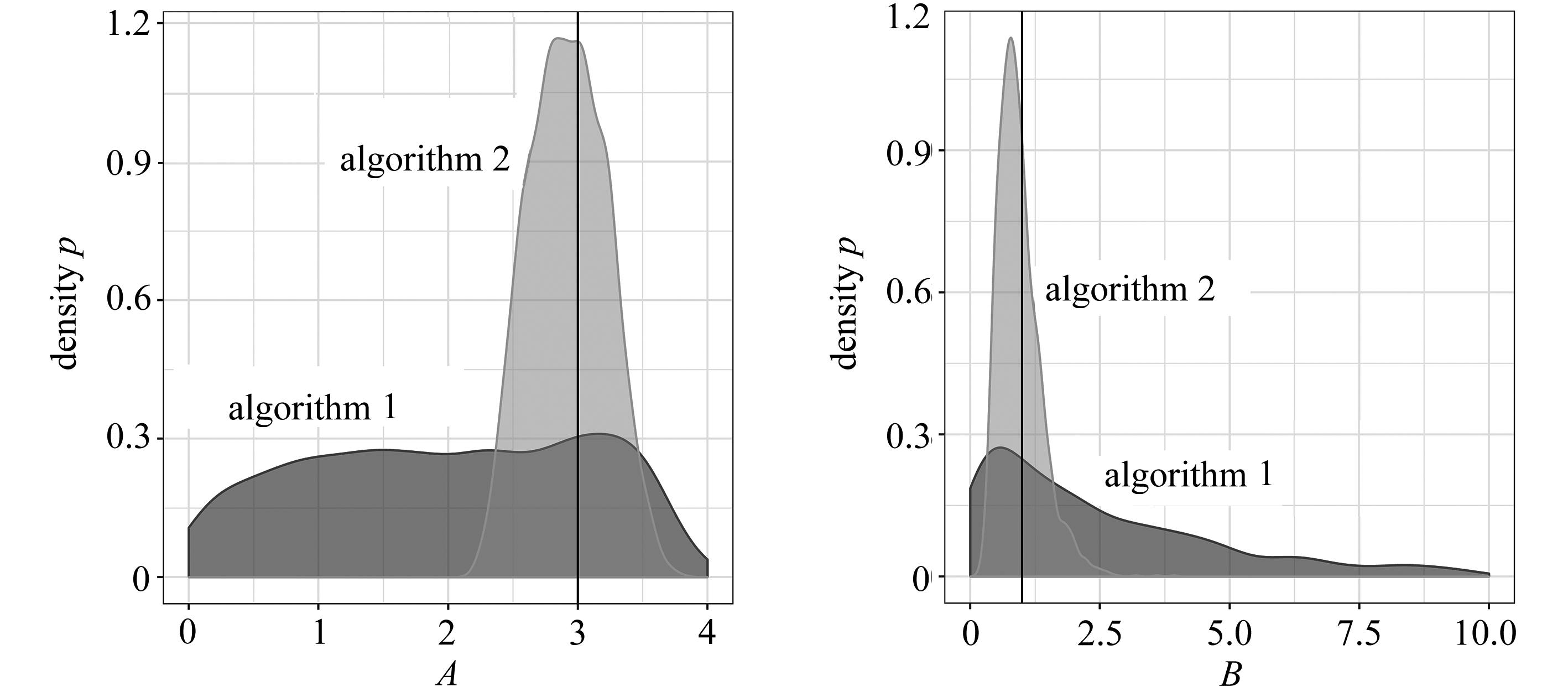

为了更充分地验证ELRELM在噪声环境下的学习性能,进一步对4个数据集triazines、pollution、MCPU和diabetes在噪声比例0%,5%,10%,15%,20%,25%,30%,35%和40%情形下进行数值实验.图2给出了4个数据集在9种不同比例噪声情形的预测精度εRMSE.由图2可知,在低比例噪声环境下,ELM在大多数情况下都取得了较好的预测精度.ELRELM在这类情形下学习性能较差.随着噪声比例的增加,尤其是噪声比例超过25%时,ELRELM的预测精度明显优于这3种对比算法.在Pollution和MCPU数据集上,ELRELM所获得了最小的εRMSE值,且与其他3种对比算法的预测精度εRMSE相差较大.这是因为本文的指数Laplace损失函数是有界函数,明确限制了噪声所造成的最大影响;同时,在训练过程中对噪声样本点赋予较小的权值,削弱这类样本点在构建回归函数过程中的作用.因此,ELRELM对含有噪声的数据集具有较稳定的泛化能力和较强的鲁棒性.

(a) Triazines (b) Pollution

(c) MCPU (d) Diabetes

图2 Triazines、pollution、MCPU和diabetes数据集在不同比例噪声下的预测精度

Fig. 2 Experimental results of triazines, pollution, MCPU and diabetes datasets with different noise levels

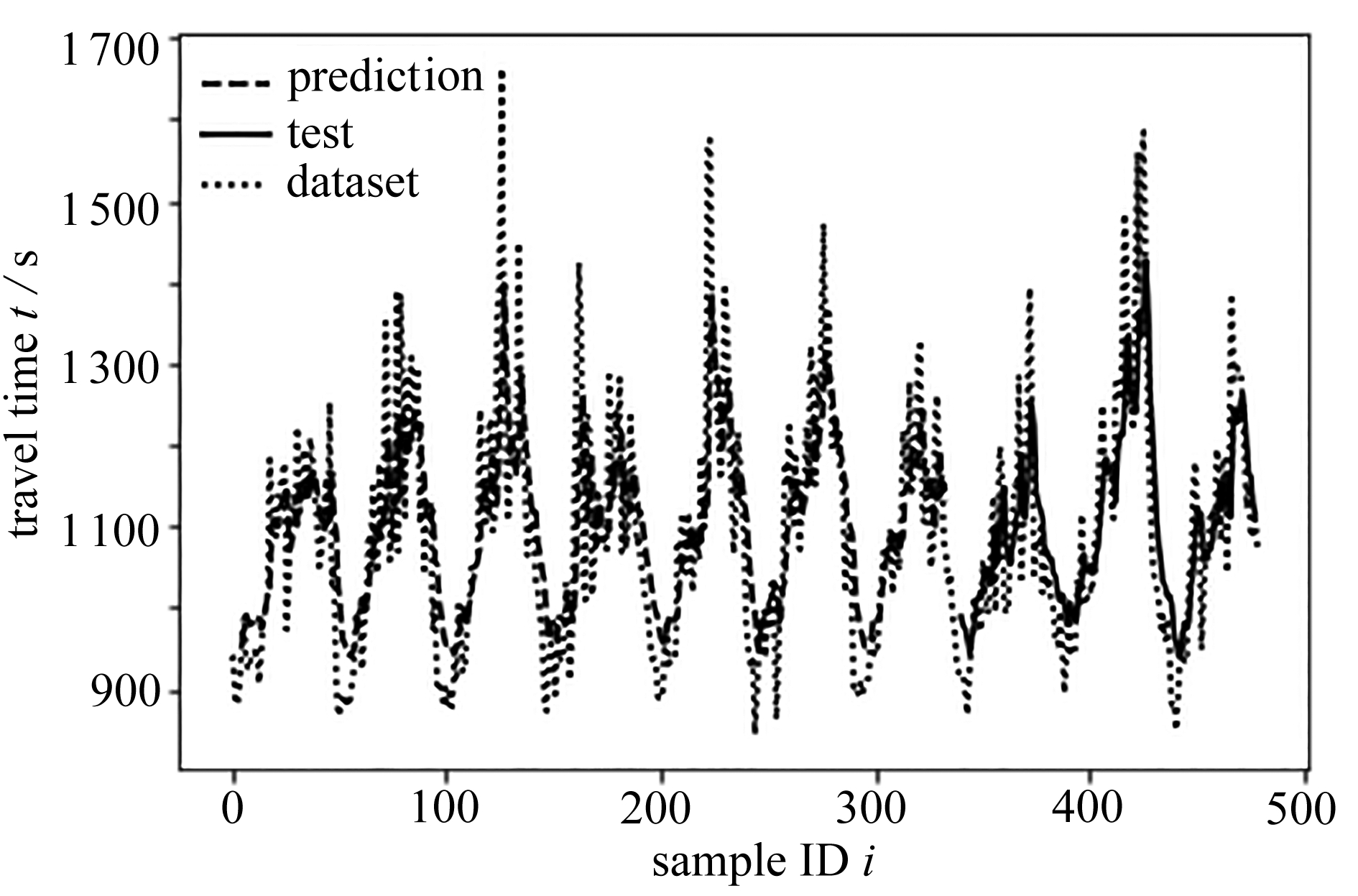

由于ELRELM是一个迭代求解算法,迭代次数对其收敛速度具有重要影响.通过数值实验分析迭代次数与ELRELM的目标函数值的关系.在实验过程中,最大迭代次数设置为20.图3给出了diabetes和pollution数据集在5% 噪声情形下迭代次数和目标函数值的影响图.根据图3,目标函数值曲线在前几次迭代中下降很快,在迭代次数不超过15收敛.因此,本文提出的ELRELM能够在较少的迭代次数内收敛,具有较快的收敛速度.

(a) Diabetes (b) Pollution

图3 Diabetes和pollution数据集上ELRELM的迭代次数与目标函数值的关系

Fig. 3 Relationships between the iteration number and the objective function for diabetes and pollution datasets

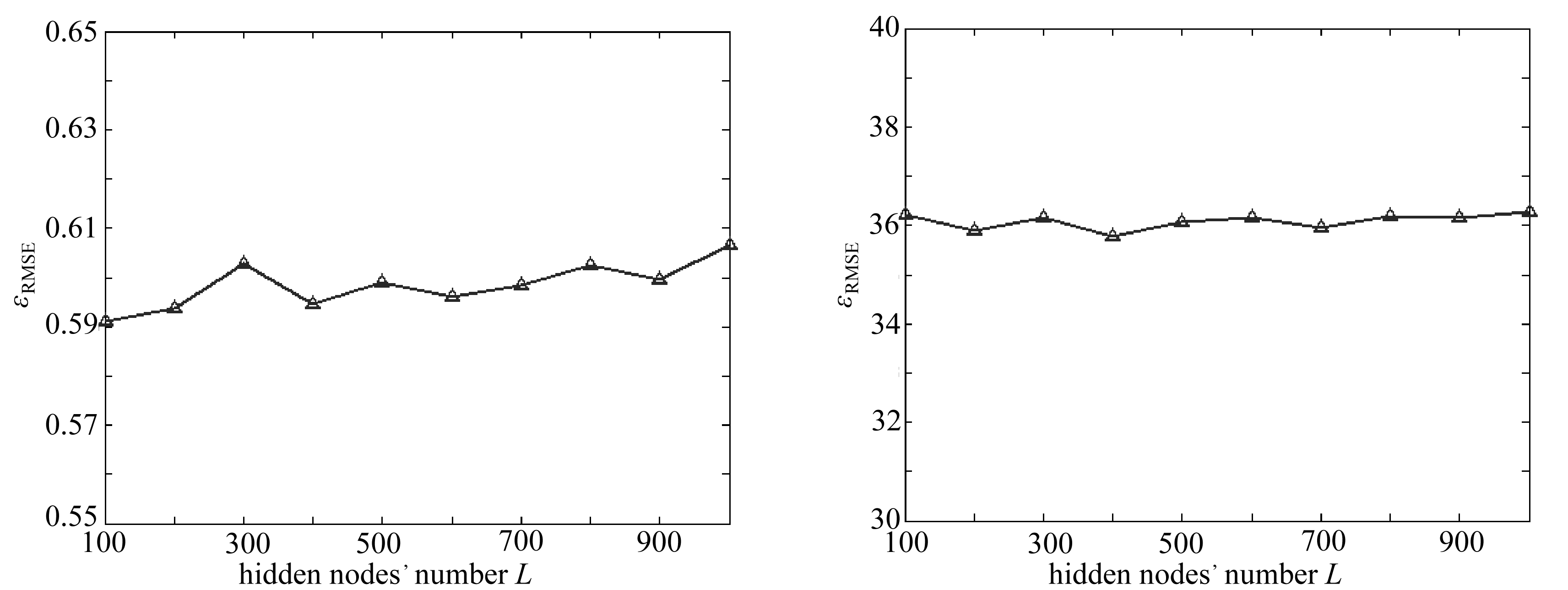

接下来分析隐节点数目L对ELRELM算法的预测结果εRMSE的影响.对diabetes和pollution数据集在10%噪声情形进行数值实验.隐节点数目L的取值范围为{100,200,300,400,500,600,700,800,900,1 000}.对不同的L值,ELRELM在最优参数(C*,λ*)情况下得到εRMSE,实验结果见图4. 由图4可以看出,隐节点数目对ELRELM的预测结果εRMSE的影响不明显,这与文献[3]的结论一致,也是ELM框架算法的一个优势.因此,为了缩短训练时间,在实验中可选取较小的L值.本文中L=200就是一个较合适的选择.

(a) Diabetes (b) Pollution

图4 Diabetes和pollution数据集上εRMSE值随隐节点数目L的变化情况

Fig. 4 Relationships between hidden nodes’ number L and εRMSE for diabetes and pollution datasets

5 结 束 语

针对回归估计问题,在超限学习机框架下,提出指数Laplace损失函数处理受噪声干扰的数据集学习问题,并在此基础上建立了鲁棒ELM模型.利用迭代重赋权算法求解相应的优化问题.在每次迭代过程中,只需求解较小规模的线性方程组.求解算法能够在较少的迭代次数内收敛.通过9个真实数据集在不同噪声环境下的数值实验验证了所提出的ELRELM模型具有较稳定且更优的学习性能.对机器学习其他问题如半监督问题、无监督问题和单分类问题,均可考虑构造相应的指数损失函数,这将是笔者下一步的研究重点.

[1] HUANG G, ZHU Q, SIEW C. Extreme learning machine: a new learning scheme of feedforward neural networks[C]//2004 IEEE International Joint Conference on Neural Networks. Budapest, Hungary, 2004: 985-990.

[2] HUANG G, ZHU Q, SIEW C. Extreme learning machine: theory and applications[J]. Neurocomputing, 2006, 70(1/3): 489-501.

[3] HUANG G, ZHOU H, DING X, et al. Extreme learning machine for regression and multiclass classification[J]. IEEE Transactions on Systems, Man, and Cybernetics, Part B (Cybernetics), 2012, 42(2): 513-529.

[4] 姜琳颖, 余东海, 石鑫. 基于加权极限学习机的肿瘤基因表达谱数据分类[J]. 东北大学学报(自然科学版), 2017, 38(6): 798-803.(JIANG Linying, YU Donghai, SHI Xin. Tumor microarray gene expression data classification based on weighted extreme learning machine[J]. Journal of Northeastern University (Natural Science), 2017, 38(6): 798-803.(in Chinese))

[5] 柯逍, 邹嘉伟, 杜明智, 等. 基于蒙特卡罗数据集均衡与鲁棒性增量极限学习机的图像自动标注[J]. 电子学报, 2017, 45(12): 2925-2935.(KE Xiao, ZOU Jiawei, DU Mingzhi, et al. The automatic image annotation based on monte-carlo data set balance and robustness incremental extreme learning machine[J]. Acta Electronica Sinica, 2017, 45(12): 2925-2935.(in Chinese))

[6] HAMPEL F, RONCHETTI E, ROUSSEEUW P, et al. Robust Statistics[M]. Wiley, 2005.

[7] FRENAY B, VERLEYSEN M. Classification in the presence of label noise: a survey[J]. IEEE Transactions on Neural Networks and Learning Systems, 2014, 25(5): 845-869.

[8] DENG W, ZHENG Q, CHEN L. Regularized extreme learning machine[C]//2009 IEEE Symposium on Computational Intelligence and Data Mining. Nashville, TN, USA, 2009: 389-395.

[9] HORATA P, CHIEWCHANWATTANA S, SUNAT K. Robust extreme learning machine[J]. Neurocomputing, 2013, 102: 31-44.

[10] ZHANG K, LUO M. Outlier-robust extreme learning machine for regression problems[J]. Neurocomputing, 2015, 151(3): 1519-1527.

[11] REN Z, YANG L. Robust extreme learning machines with different loss functions[J]. Neural Processing Letters, 2019, 49(3): 1543-1565.

[12] CHEN K, LÜ Q, LU Y, et al. Robust regularized extreme learning machine for regression using iteratively reweighted least squares[J]. Neurocomputing, 2017, 230: 345-358.

[13] WANG L, JIA H, LI J. Training robust support vector machine with smooth ramp loss in the primal space[J]. Neurocomputing, 2008, 71(13/15): 3020-3025.

[14] SHEN X, NIU L, QI Z, et al. Support vector machine classifier with truncated pinball loss[J]. Pattern Recognition, 2017, 68: 199-210.

[15] ZHONG P. Training robust support vector regression with smooth non-convex loss function[J]. Optimization Methods & Software, 2012, 27(6): 1039-1058.

[16] JIANG W, NIE F, HUANG H. Robust dictionary learning with capped l1 norm[C]//Twenty-Fourth International Joint Conference on Artificial Intelligence. Buenos Aires, Argentina, 2015.

[17] LIU W, POKHAREL P, PRINCIPE J. Correntropy: properties and applications in non-Gaussian signal processing[J]. IEEE Transactions on Signal Processing, 2007, 55(11): 5286-5298.

[18] HE R, HU B, YUAN X,et al. Robust Recognition Via Information Theoretic Learning[M]. Springer, 2014.

[19] XING H, WANG X. Training extreme learning machine via regularized correntropy criterion[J].Neural Computing and Applications, 2013, 23(7/8): 1977-1986.

[20] SINGH A, POKHAREL R, PRINCIPE J. The C-loss function for pattern classification[J]. Pattern Recognition, 2014, 47(1): 441-453.

[21] FENG Y, YANG Y, HUANG X, et al. Robust support vector machines for classification with nonconvex and smooth losses[J]. Neural Computation, 2016, 28(6): 1217-1247.

[22] YANG L, REN Z, WANG Y, et al. A robust regression framework with Laplace kernel-induced loss[J]. Neural Computation, 2017, 29(11): 3014-3039.