引言

近年来,多智能体系统的协调追踪控制在生物系统集聚现象[1]、传感器网络[2]、无人飞行器编队控制[3]等领域取得了广泛应用.主-从一致性是协调追踪控制中的一类典型问题,它是指所有跟随者在适当的控制输入下趋向于领导者状态[4].因此,针对此类问题的研究受到了众多团队的密切关注[5-6].

现有的研究结果往往仅关注一致性问题,但是最优化作为一个重要特性没有受到充分的关注,目前仅有少量的研究结果.众所周知,优化问题的解可以通过对Hamilton-Jacobi-Bellman(HJB)方程的求解获得.然而,对于非线性系统HJB方程的求解,至今依旧是一个很大的难点.动态规划(dynamic programming, DP)是一种非常有效的求解优化控制问题的方法,但是对于非线性系统,随着维数的增长,计算量会呈指数倍增长,使得该算法实现越来越不可能.为了克服这一困难,Werbos首次提出自适应动态规划(adaptive dynamic programming, ADP)求解算法,受到了广泛关注,并被众多学者进一步地发展[7-11].Abu-Khalaf和Lewis提出一种基于神经网络的最优算法,得出了一类具有控制约束的非线性系统的最优控制[12].Liu等将ADP算法推广到具有无限时域的非线性离散系统上,并证明了算法的收敛性[13].近年来,Zhang及其合作者在开发ADP算法求解最优控制问题上取得了众多成果[14-15].文献[14]针对具有约束控制的非线性离散系统,提出了一种新颖的迭代ADP算法并证明了收敛性.文献[15]针对连续时间系统的最优跟踪问题,设计了一种新的ADP在线算法.

由于现实环境的复杂性,高维的多智能体系统动力学行为一般很难精确获得.在多智能体系统一致优化的研究中,越来越多的学者开始将强化学习中的行为-批评(actor-critic, AC)网络架构和ADP算法整合[16-18].行为-批评网络架构是一种不依赖于模型的算法,利用神经网络来近似动态规划中的最优值函数和最优控制策略,通过环境或者被控对象在不同阶段产生的奖励惩罚来影响批评网络和行为网络,从而来获得最优值函数和最优控制以满足最优性原理.文献[16]针对一类离散时间多智能体系统,使用强化学习方法,提出了一种基于数据驱动的ADP解决了最优一致问题.文献[17]提出了一种identifier-actor-critic强化学习算法,实现了非线性多智能体系统的主-从编队优化控制.文献[18]利用一种基于观测器的ADP方法,解决了非线性多智能体系统的最优协同跟踪控制问题.

为减少控制任务的执行次数,降低通讯资源和计算资源的消耗,事件触发控制方法逐渐成为了一种有效的控制模式.相比于传统的连续时间采样控制,事件触发控制提供了一种非周期策略用来传输系统状态和控制输入,即仅在违反事件触发条件时才对系统状态进行采样.近年来,事件触发控制在线性系统[19-20]、非线性系统[21-22]、多智能体系统[23]等领域取得了广泛的应用.值得一提的是,Dong和Sun等在文献[22]中首次将事件驱动策略和AC算法整合,实现了连续时间系统具有约束条件的最优控制.然而,基于事件触发的多智能体系统最优一致性问题尚未被充分研究,仅有极少量的文献提及此类问题的重要性,本文的主要目的就是填补这一空白.基于上述文献的启发,本研究针对通讯拓扑结构已知的线性多智能体系统,将事件触发策略和AC网络架构整合,实现了多智能体系统最优主从一致性控制,并且利用Lyapunov方法,对误差系统的有界性和稳定性进行了分析.

1 问 题 描 述

1.1 代数图论

在多智能体系统中,各智能体之间的通讯拓扑可以使用无向图描述[24].现考虑多智能体系统的无向图为![]() 其中ν={0,1,2,…,N}为节点集,0表示领导者,其余表示跟随者.ξ⊆ν×ν为系统边界集合

其中ν={0,1,2,…,N}为节点集,0表示领导者,其余表示跟随者.ξ⊆ν×ν为系统边界集合![]() 为跟随者的邻接矩阵且aij≥0.当且仅当节点i与j之间存在一条边,即

为跟随者的邻接矩阵且aij≥0.当且仅当节点i与j之间存在一条边,即![]() 时aij>0,否则aij=0.因此节点i的相邻节点集可表示为

时aij>0,否则aij=0.因此节点i的相邻节点集可表示为![]() 为领导者的邻接矩阵.定义度矩阵为D=diag{di,i=1,2,…,N},其中

为领导者的邻接矩阵.定义度矩阵为D=diag{di,i=1,2,…,N},其中![]() 为Laplace算子.记H=(L+B)⊗In.Ξ为Rn的一个紧集.

为Laplace算子.记H=(L+B)⊗In.Ξ为Rn的一个紧集.

1.2 模型描述

考虑如下带有领导者与跟随者的多智能体系统:

(1)

式中,A∈Rn×n为常数矩阵,xi(t)∈Rn与ui(t)∈Rn分别为智能体i的状态与控制输入,x0(t)为领导者状态.

定义1 针对多智能体系统(1),给定任意的初始状态xi(0),i=1,2,…,N,若满足limt→∞‖xi(t)-x0(t)‖=0,则称该系统达到主-从一致.

为了研究最优协调追踪控制问题,定义智能体i的局部追踪误差ei为

(2)

引入Kronecker乘积,则多智能体系统的全局追踪误差为

(3)

![]() 分别表示全局误差与状态向量,

分别表示全局误差与状态向量,![]() 表示元素全为1的N维列向量,In为n阶单位阵.

表示元素全为1的N维列向量,In为n阶单位阵.

注1 由于H为正定阵,因此e(t)→0等价于![]() 这意味着多智能体系统达到主-从一致,即所有跟随者都服从于领导者.

这意味着多智能体系统达到主-从一致,即所有跟随者都服从于领导者.

定义2(允许控制) 若任意的控制输入ui不仅使得系统(2)稳定,而且能够使局部性能指标有界,则称ui为允许控制.

定义智能体i的局部性能指标为

(4)

式中,![]() 为相邻节点j的控制输入,同时Qii>0,Rii>0,Rij≥0.当且仅当节点j为节点i的相邻接点时Rij>0,否则Rij=0.相应地,局部值函数定义为

为相邻节点j的控制输入,同时Qii>0,Rii>0,Rij≥0.当且仅当节点j为节点i的相邻接点时Rij>0,否则Rij=0.相应地,局部值函数定义为

(5)

针对于智能体i,目标是找到一个允许控制ui,使得多智能体趋于一致同时局部值函数最小:

(6)

根据文献[10]可知,智能体i的Lyapunov方程(LE)为

(7)

假设局部最优值函数![]() 满足上述LE方程,则依据Bellman最优性原理,得出局部最优控制为

满足上述LE方程,则依据Bellman最优性原理,得出局部最优控制为

(8)

1.3 事件触发控制

针对于智能体i,事件触发序列![]() 定义如下:

定义如下:

(9)

式中,Pi为触发阈值,多智能体误差系统的事件触发误差![]() 表示所有智能体的事件触发时间集合.

表示所有智能体的事件触发时间集合.

2 基于事件触发的近似最优控制

2.1 批评网络

基于批评网络的智能体i的最优值函数可写为

(10)

式中,![]() 为目标权重矩阵,φci∈Rn为激活函数,εci为结构误差,上式关于ei求偏导为

为目标权重矩阵,φci∈Rn为激活函数,εci为结构误差,上式关于ei求偏导为

(11)

假设1 在批评网络中,目标权重矩阵Wci与激活函数φci及结构误差εci都是有界的,即‖Wci‖≤WcM,‖φci‖≤φcM,|εci|≤εcM;同时激活函数与结构误差的梯度 φci,

φci, εci也都是有界的,即‖

εci也都是有界的,即‖ φci‖≤

φci‖≤ φcM,‖

φcM,‖ εci‖≤

εci‖≤ εcM,

εcM, φcM,

φcM, εcM为大于零的常数.

εcM为大于零的常数.

利用批评网络(10)的逼近性质来估计值函数,则LE方程为

(12)

由于目标权重矩阵Wci未知,因此批评网络的实际输出可表示为

(13)

式中![]() 为未知目标权重矩阵Wci的估计值,

为未知目标权重矩阵Wci的估计值,![]() 为估计目标值函数.因此估计的LE方程为

为估计目标值函数.因此估计的LE方程为

(14)

批评网络的目标是选择一个恰当的![]() 使得误差函数最小:

使得误差函数最小:

(15)

估计权重![]() 更新规则如下:

更新规则如下:

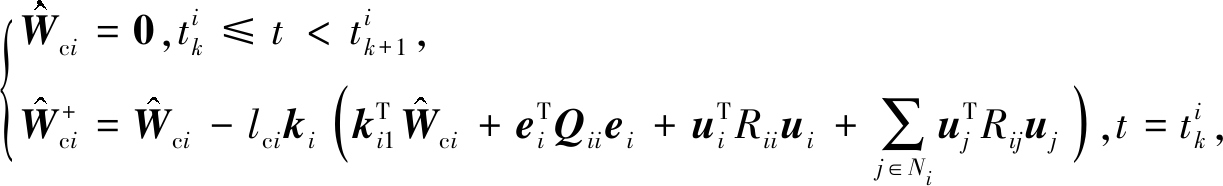

(16)

式中,![]() 为智能体i的权重学习率,且0<lci<1.

为智能体i的权重学习率,且0<lci<1.

2.2 行为网络

基于行为网络的智能体i的最优控制输入可写为

(17)

假设2 在行为网络中,目标权重矩阵Wai∈Rn×n与激活函数φai∈Rn及结构误差εai∈Rn都是有界的,即

‖Wai‖≤‖Wa‖≤WaM, ‖φai‖≤‖φa‖≤φaM, ‖εai‖≤‖εa‖≤εaM;同时激活函数的梯度 φai是有界的,即‖

φai是有界的,即‖ φai‖≤

φai‖≤ φaM,

φaM, φaM为大于零的常数.对任意ei∈Ξ,激活函数φaiLeibniz连续,即

φaM为大于零的常数.对任意ei∈Ξ,激活函数φaiLeibniz连续,即

同时

引入Hadamard乘积,可得

由于目标权重Wai未知,因此行为网络的事件触发近似最优控制为

(18)

式中,![]() 和

和![]() 分别为估计近似最优控制和估计权重.定义行为网络的误差函数为

分别为估计近似最优控制和估计权重.定义行为网络的误差函数为

(19)

类似于批评网络,行为网络则是选择一个恰当的![]() 使得误差函数最小:

使得误差函数最小:

(20)

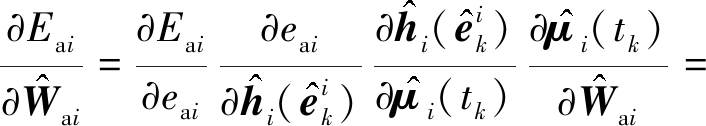

基于神经网络的误差反向传播原理对权重进行更新,更新梯度如下:

Wci,n+1

![]()

(21)

Wci,n+1表示与行为网络控制输入相关的批评权重的绝对值.因此估计权重![]() 的更新规则如下:

的更新规则如下:

(22)

式中,lai为智能体i的权重学习率,且0<lai<1.

由于批评网络和行为网络的权重都只在触发瞬间更新,因此本文希望设计一个合适的控制器,使得误差系统稳定.上述两个网络的权重估计误差定义为

(23)

注2 本文基于多智能体系统的内部通讯拓扑结构,利用行为-批评网络研究了各个智能体的一致性.因此相比于文献[22],本研究充分考虑了邻接节点的控制信息,解决了内部结构更加复杂的系统的一致性.

定理1 考虑多智能体系统(1),如果假设1和假设2成立,同时批评网络与行为网络权重按式(16)、(22)更新,则在如下的事件触发条件下多智能体的误差系统(3)是最终有界的:

(24)

式中,0<β<1,σ>0,η>0,δ>0为设计参数.

证明 为了证明系统的有界性,需要考虑下述两类情形.

情形1 事件未被触发![]()

针对智能体i,考虑如下Lyapunov函数:

Li(t)=Li1(t)+Li2(t)+Li3(t),

(25)

式中,![]() 其中

其中![]() 同时

同时

(26)

利用式(7)、(13)、(18),式(26)可化为

(( φci)T(hi(ei))Wci+

φci)T(hi(ei))Wci+ εci)T×

εci)T×

![]()

φci)T(ei)Wci+

φci)T(ei)Wci+ εci‖2+

εci‖2+

-λmin(Qii)‖ei‖2+

![]()

上式中

εtotal=

![]()

则

(27)

因此,当![]() 时,

时,![]() 即系统在事件间隔期间是最终有界的.

即系统在事件间隔期间是最终有界的.

情形2 事件被触发(t=tk)

对于相同的Lyapunov函数:

Li(t)=Li1(t)+Li2(t)+Li3(t).

(28)

第一项的一阶差分为

(29)

同时![]() 于是

于是

(30)

因此

(31)

行为网络权重更新为![]() 则第二项一阶差分为

则第二项一阶差分为

(32)

当t=tk时,![]() 综上,可得

综上,可得

ΔLi(t)=ΔLi1(t)+ΔLi2(t)+ΔLi3(t)≤

(33)

式中

![]()

φaM)2.

φaM)2.

即当![]() 或

或![]() 时,ΔLi≤0,系统在触发瞬间是最终有界的.

时,ΔLi≤0,系统在触发瞬间是最终有界的.

接下来证明近似最优控制为允许控制,由上述分析可得

(34)

上式中,已知触发条件Pi随着时间的推移趋于零,同时φaM,εaM可以取到接近于零的数,因此事件触发近似最优控制![]() 最终会趋向于最优控制

最终会趋向于最优控制![]() 即

即![]() 为允许控制.

为允许控制.

注3 在事件触发瞬间,系统状态xi(t)与近似最优控制μi(tk)都进行了更新.然后,近似最优控制μi(tk)保持不变直到下次事件触发瞬间再次进行更新.上述理论分析也证明了触发条件(24)能够对系统(1)进行有效地控制,同时相比于连续时间控制器,也节省了通讯资源与计算资源.

3 数 值 仿 真

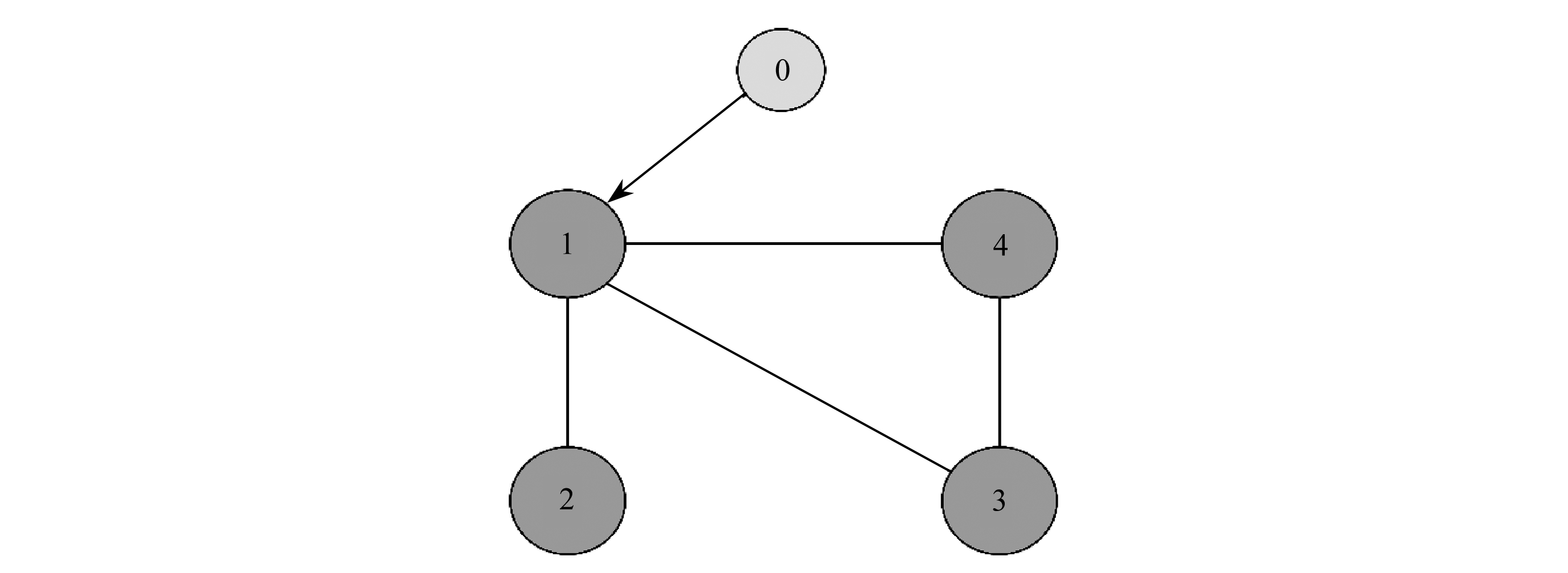

本节给出了一个数值例子来说明上述理论结果的可行性和有效性.考虑带有1个领导者和4个跟随者的多智能体系统,图1为该多智能体系统的通讯拓扑图.

图1 多智能体系统通讯拓扑图

Fig. 1 The communication topology of the multi-agent system

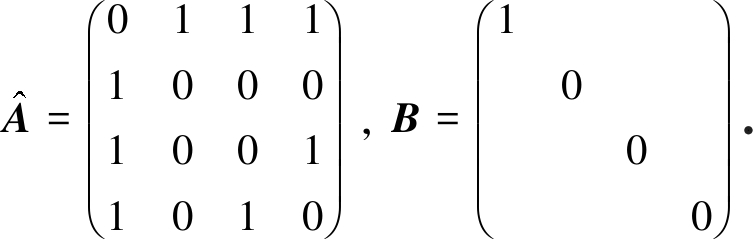

定义跟随者与领导者的邻接矩阵![]() 与B分别如下:

与B分别如下:

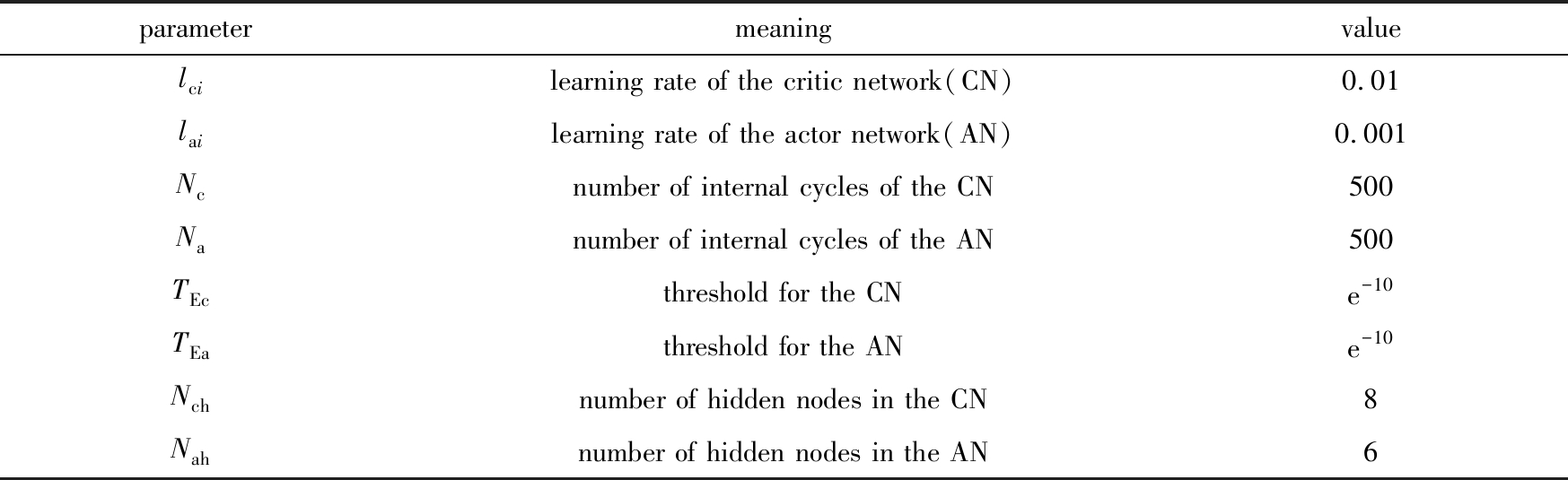

不失一般性,令维数n=1.进而假设该多智能体的系统矩阵A=-2,领导者的初始状态为x0(0)=5,第i个跟随者的初始状态为xi(0)=4×i,i=1,2,3,4.记控制时间T=10,每次更新步长H=0.001.批评网络与行为网络中参数设置分别如下.

表1 批评-行为网络参数取值

Table 1 Values of actor-critic network parameters

parametermeaningvaluelcilearningrateofthecriticnetwork(CN)0.01lailearningrateoftheactornetwork(AN)0.001NcnumberofinternalcyclesoftheCN500NanumberofinternalcyclesoftheAN500TEcthresholdfortheCNe-10TEathresholdfortheANe-10NchnumberofhiddennodesintheCN8NahnumberofhiddennodesintheAN6

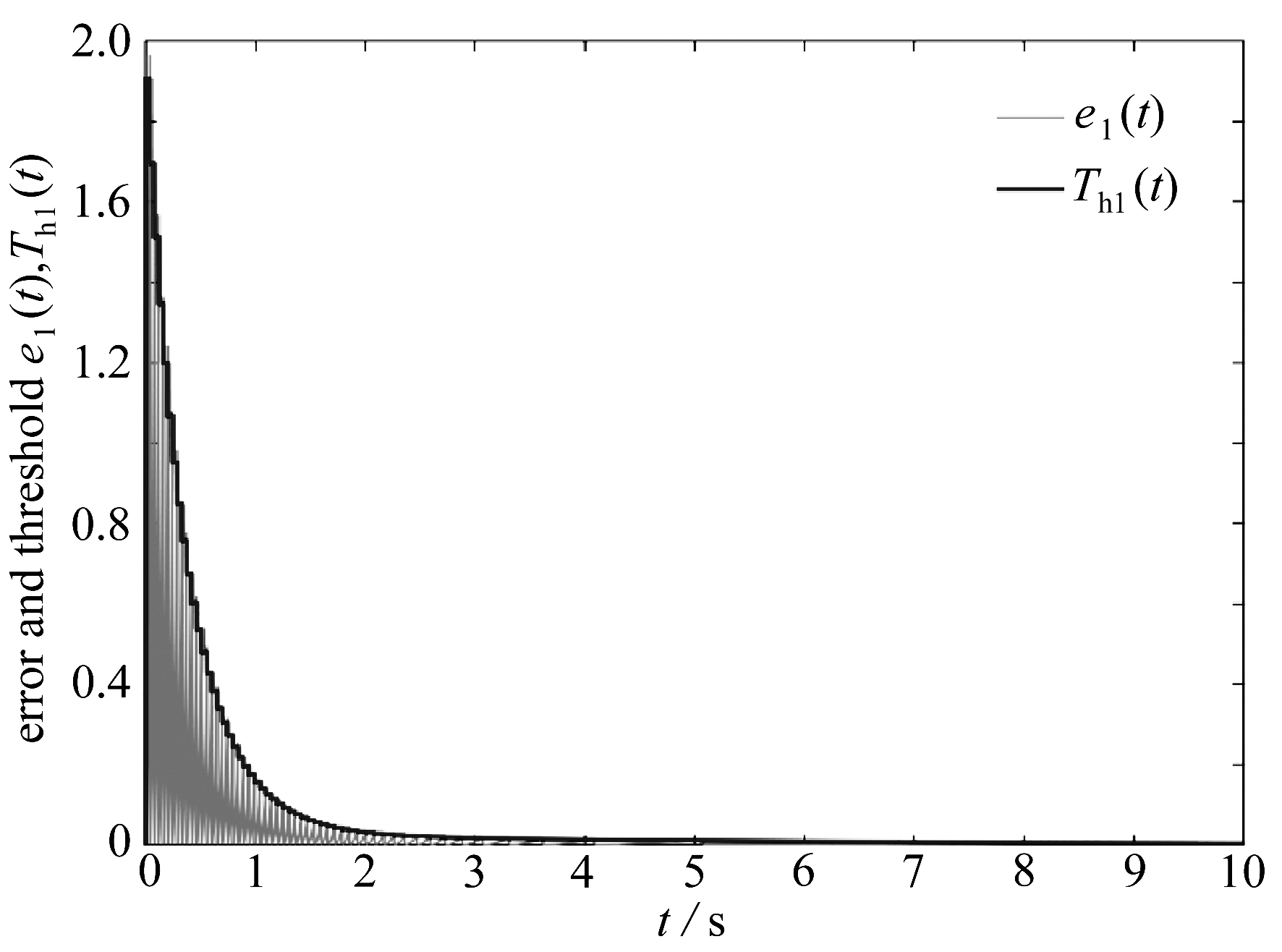

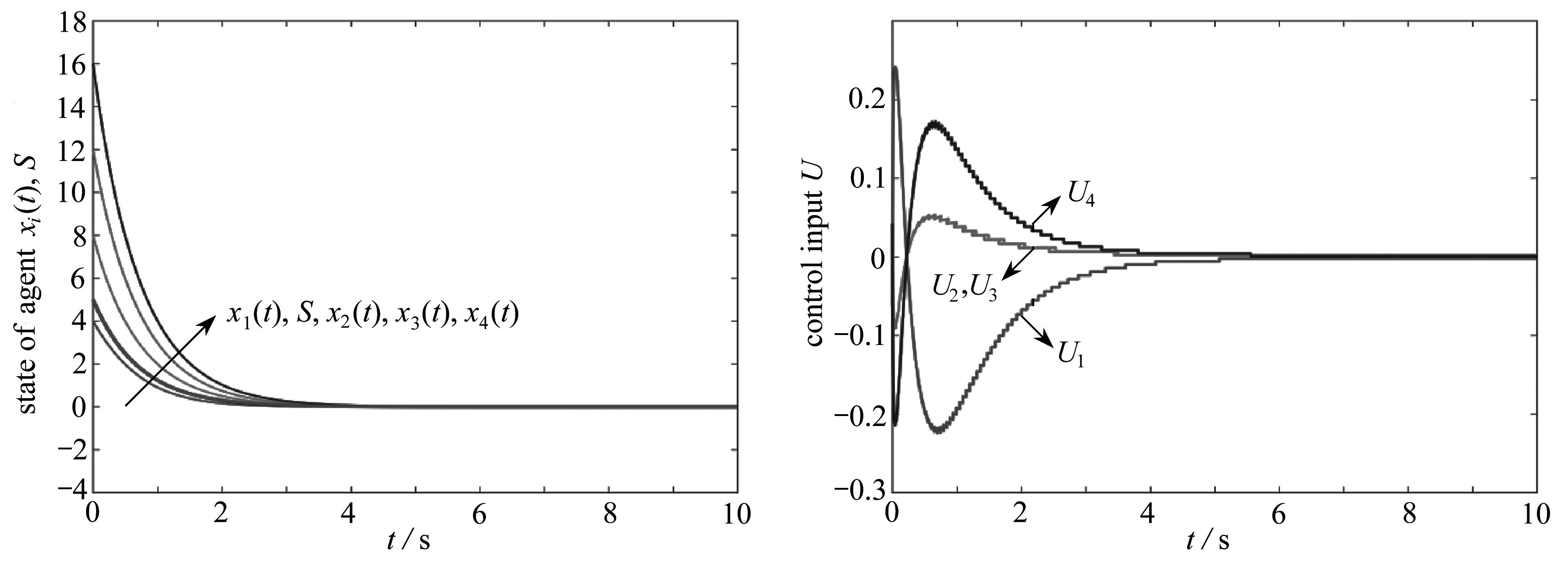

事件触发条件(24)中各参数取值分别为Qii=1, β=0.7, La=2.5, σ=0.03, η=1.5, δ=0.5.基于此,多智能体系统的数值仿真结果如图2~4所示.图2为多智能体系统中智能体1的事件触发阈值及状态误差的变化轨迹图.由图2可知,在基于事件触发的自适应动态规划下,节点1的误差最终趋于零.图3为多智能体系统中各智能体的状态变化轨迹图.由图3可知,随着控制时间的推移,4个跟随者都与领导者达到最终一致.图4为基于神经网络设计出的近似最优控制的变化轨迹图.由图4可知,在初期跟随者与领导者状态差别较大的情况下,控制器作用较大,在后期跟随者与领导者状态趋于一致后,各个智能体的控制器均趋于零,与图2结果互相吻合.

图2 智能体1的误差及触发阈值

Fig. 2 Errors and trigger thresholds of agent 1

本研究针对多智能体系统设计了一种基于行为-批评网络的强化学习算法,利用行为网络逼近最优控制,利用批评网络逼近值函数,并且这两个网络都只在事件触发瞬间更新.由图2~4可知,该算法对模型取得了有效的控制.并且相比于文献[19]中通过设计控制增益矩阵K求解控制输入,本文算法具有更高的容错率和资源节省率.

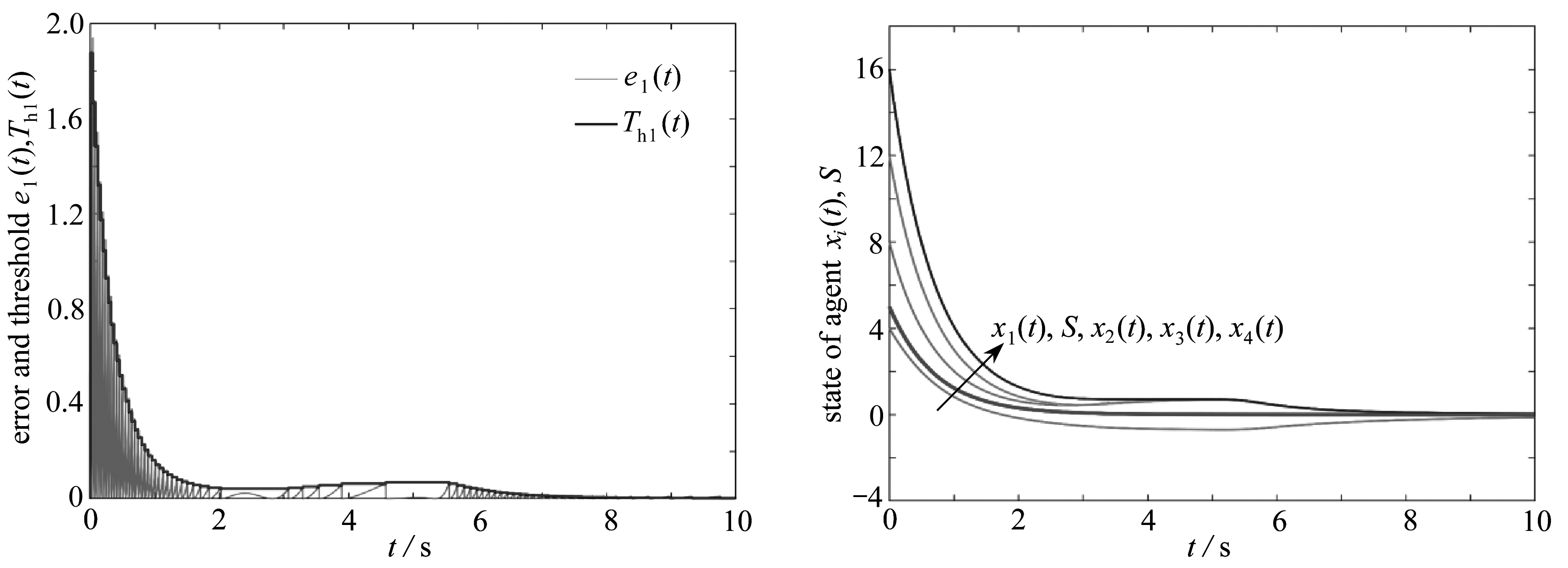

将事件触发条件(24)中的指数项ση-δt去除则变为文献[22]中的事件触发条件.利用文献[22]中的事件触发条件去控制上述案例,运行出的数值仿真结果如图5、6所示.由图可知,该多智能体系统需要7~8 s才能趋于主-从一致,同时事件触发次数也有所增加.

图3 各智能体的状态轨迹 图4 各跟随者的优化控制

Fig. 3 State trajectories of each agent Fig. 4 Optimal control of each follower

图5 智能体1的误差及触发阈值 图6 各智能体的状态轨迹

Fig. 5 Errors and trigger thresholds of agent 1 Fig. 6 State trajectories of each agent

事件触发阈值中的参数设置起到了至关重要的作用,它控制着事件触发次数和收敛速度.相比于文献[22]中的事件触发阈值,本研究的事件触发阈值函数添加了一项ση-δt,因此通过设置参数σ,η,δ的大小能够更加灵活地控制触发次数及收敛速度.同时本研究中事件触发阈值Pi始终大于0,这在一定程度上延长了事件触发间隔,也进一步验证了所提出的事件触发方法的有效性.

4 结 论

本研究基于事件触发的自适应动态规划方法,分析了多智能体的一致性.进而设计出了近似最优控制,证明了多智能体的误差系统最终有界,也验证了多智能体系统的主-从一致性.本文为后期研究带有控制约束的非线性多智能体系统的主-从一致性提供了一定的理论依据.

[1] SU H, WANG X, LIN Z. Flocking of multi-agents with a virtual leader[J]. IEEE Transactions on Automatic Control, 2009, 54(2): 293-307.

[2] JI H, LEWIS F L, HOU Z, et al. Distributed information-weighted Kalman consensus filter for sensor networks[J]. Automatica, 2017, 77: 18-30.

[3] HU Q, ZHANG J. Relative position finite-time coordinated tracking control of spacecraft formation without velocity measurements[J]. ISA Transactions, 2015, 54: 60-74.

[4] LI H, LIAO X, HUANG T, et al. Event-triggering sampling based leader-following consensus in second-order multi-agent systems[J]. IEEE Transactions on Automatic Control, 2015, 60(7): 1998-2003.

[5] WEN G X, CHEN C L P, LIU Y J, et al. Neural-network-based adaptive leader-following consensus control for second-order non-linear multi-agent systems[J]. IET Control Theory & Applications, 2015, 9(13): 1927-1934.

[6] DEFOORT M, POLYAKOV A, DEMESURE G, et al. Leader-follower fixed-time consensus for multi-agent systems with unknown non-linear inherent dynamics[J]. IET Control Theory & Applications, 2015, 9(14): 2165-2170.

[7] BERTSEKAS D P, TSITSIKLIS J N. Neuro-Dynamic Programming[M]. Belmont, MA: Athena Scientific, 1996.

[8] PROKHOROV D V, WUNSCH D C. Adaptive critic designs[J]. IEEE Transactions on Neural Networks, 1997, 8(5): 997-1007.

[9] MURRAY J J, COX C J, LENDARIS G G, et al. Adaptive dynamic programming[J]. IEEE Transactions on Systems, Man, and Cybernetics, Part C (Applications and Reviews), 2002, 32(2): 140-153.

[10] WANG F Y, ZHANG H, LIU D. Adaptive dynamic programming: an introduction[J]. IEEE Computational Intelligence Magazine, 2009, 4(2): 39-47.

[11] LI H, LIU D. Optimal control for discrete-time affine non-linear systems using general value iteration[J]. IET Control Theory & Applications, 2012, 6(18): 2725-2736.

[12] ABU-KHALAF M, LEWIS F L. Nearly optimal control laws for nonlinear systems with saturating actuators using a neural network HJB approach[J]. Automatica, 2005, 41(5): 779-791.

[13] LIU D, WEI Q. Policy iteration adaptive dynamic programming algorithm for discrete-time nonlinear systems[J]. IEEE Transactions on Neural Networks and Learning Systems, 2013, 25(3): 621-634.

[14] ZHANG H, LUO Y, LIU D. Neural-network-based near-optimal control for a class of discrete-time affine nonlinear systems with control constraints[J]. IEEE Transactions on Neural Networks, 2009, 20(9): 1490-1503.

[15] QIN C, ZHANG H, LUO Y. Online optimal tracking control of continuous-time linear systems with unknown dynamics by using adaptive dynamic programming[J]. International Journal of Control, 2014, 87(5): 1000-1009.

[16] ZHANG H, JIANG H, LUO Y, et al. Data-driven optimal consensus control for discrete-time multi-agent systems with unknown dynamics using reinforcement learning method[J]. IEEE Transactions on Industrial Electronics, 2017, 64(5): 4091-4100.

[17] WEN G, CHEN C L P, FENG J, et al. Optimized multi-agent formation control based on an identifier-actor-critic reinforcement learning algorithm[J]. IEEE Transactions on Fuzzy Systems, 2018, 26(5): 2719-2731.

[18] ZHAO W, LI R, ZHANG H. Leader-follower optimal coordination tracking control for multi-agent systems with unknown internal states[J]. Neurocomputing, 2017, 249: 171-181.

[19] ZHU W, JIANG Z P. Event-based leader-following consensus of multi-agent systems with input time delay[J]. IEEE Transactions on Automatic Control, 2015, 60(5): 1362-1367.

[20] TAN X, CAO J, LI X, et al. Leader-following mean square consensus of stochastic multi-agent systems with input delay via event-triggered control[J]. IET Control Theory & Applications, 2017, 12(2): 299-309.

[21] TALLAPRAGADA P, CHOPRA N. On event triggered tracking for nonlinear systems[J]. IEEE Transactions on Automatic Control, 2013, 58(9): 2343-2348.

[22] DONG L, ZHONG X N, SUN C Y, et al. Event-triggered adaptive dynamic programming for continuous-time systems with control constraints[J]. IEEE Transactions on Neural Networks and Learning Systems, 2016, 28(8): 1941-1952.

[23] XU W, HO D W C, LI L, et al. Event-triggered schemes on leader-following consensus of general linear multiagent systems under different topologies[J]. IEEE Transactions on Cybernetics, 2015, 47(1): 212-223.

[24] 朱伟, 陈波. 具有领导者的非线性分数阶多智能体系统的一致性分析[J]. 应用数学和力学, 2015, 36(5): 555-562.(ZHU Wei, CHEN Bo. Leader-following consensus of fractional-order multi-agent systems with nonlinear models[J]. Applied Mathematics and Mechanics, 2015, 36(5): 555-562.(in Chinese))